请问具体怎么使用ros2 topic echo打印出来发布的包含骨骼关键点的ros msg,需要编译吗,编译报错tros少文件,现在我tros版本是1.0.5,可能是要升级tros或者用旧版本的骨骼提取算法是吧

不需要重新编译。

你的版本太低了,最新版本是1.1.2,参考手册升级:2.2. apt安装与升级 — 地平线机器人平台用户手册 1.0 文档 (horizon.ai)

升级完成后,直接运行人体关键点检测算法示例,参考手册:人体检测和跟踪 — 地平线机器人平台用户手册 1.0 文档 (horizon.ai)-

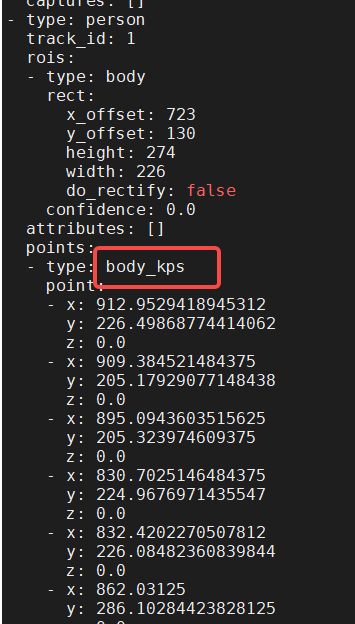

运行起来算法之后,再开启一个窗口,运行命令source /opt/tros/setup.bash; ros2 topic echo /hobot_mono2d_body_detection 会在终端输出检测到的人体关键点数据:

感谢,已实现

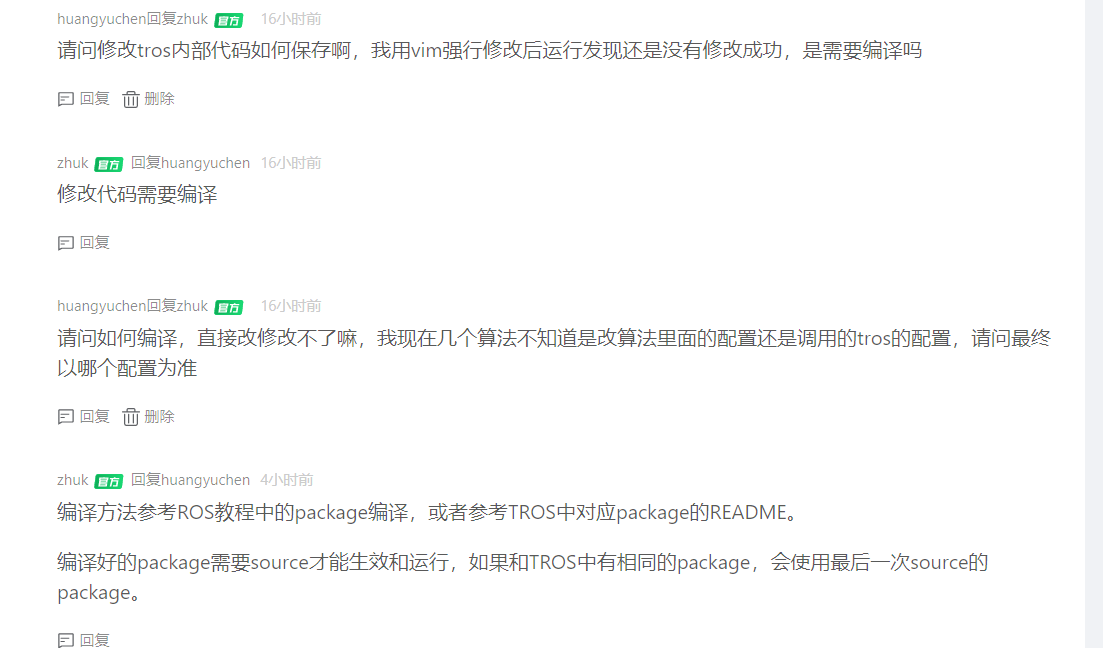

现在想自定义显示的骨骼点,只显示手臂头等关键点的坐标,需要编译后修改源文件是吧

请问旭日X3支持网络摄像机吗,如何拉流

TROS里面没有拉流示例,可以参考X3派里的示例:3.2. 图像多媒体示例 — 旭日X3派用户手册 1.0.1 文档 (horizon.ai)

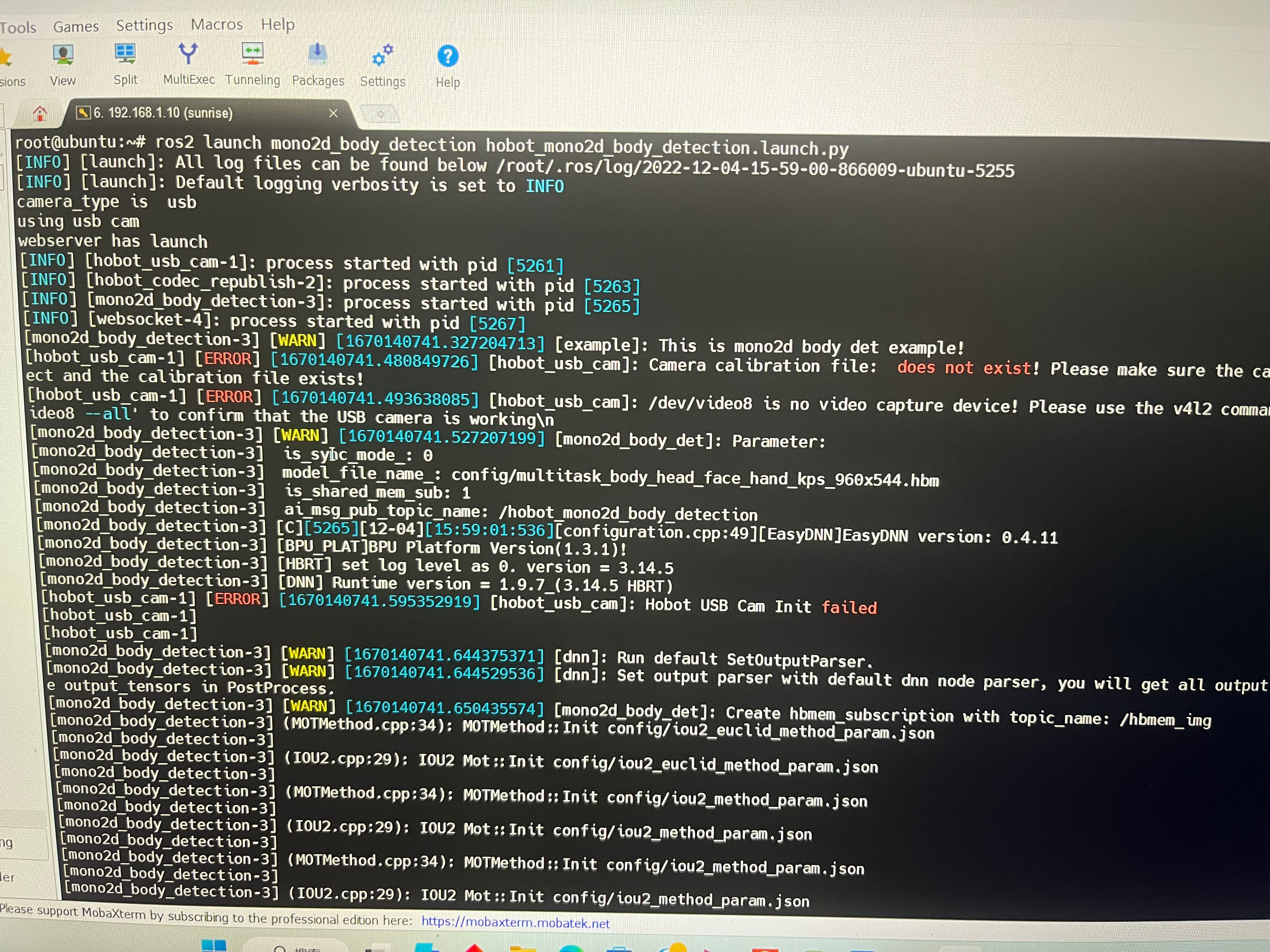

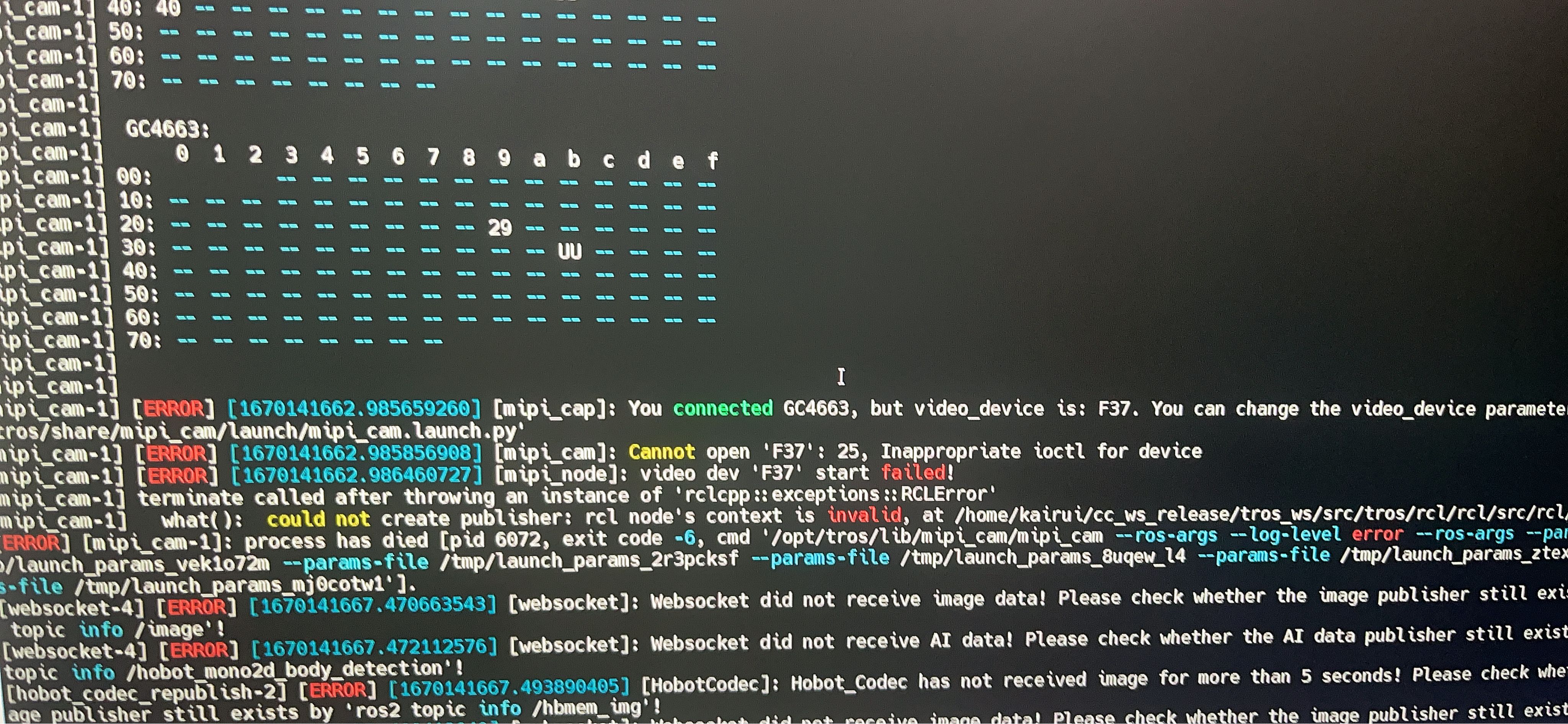

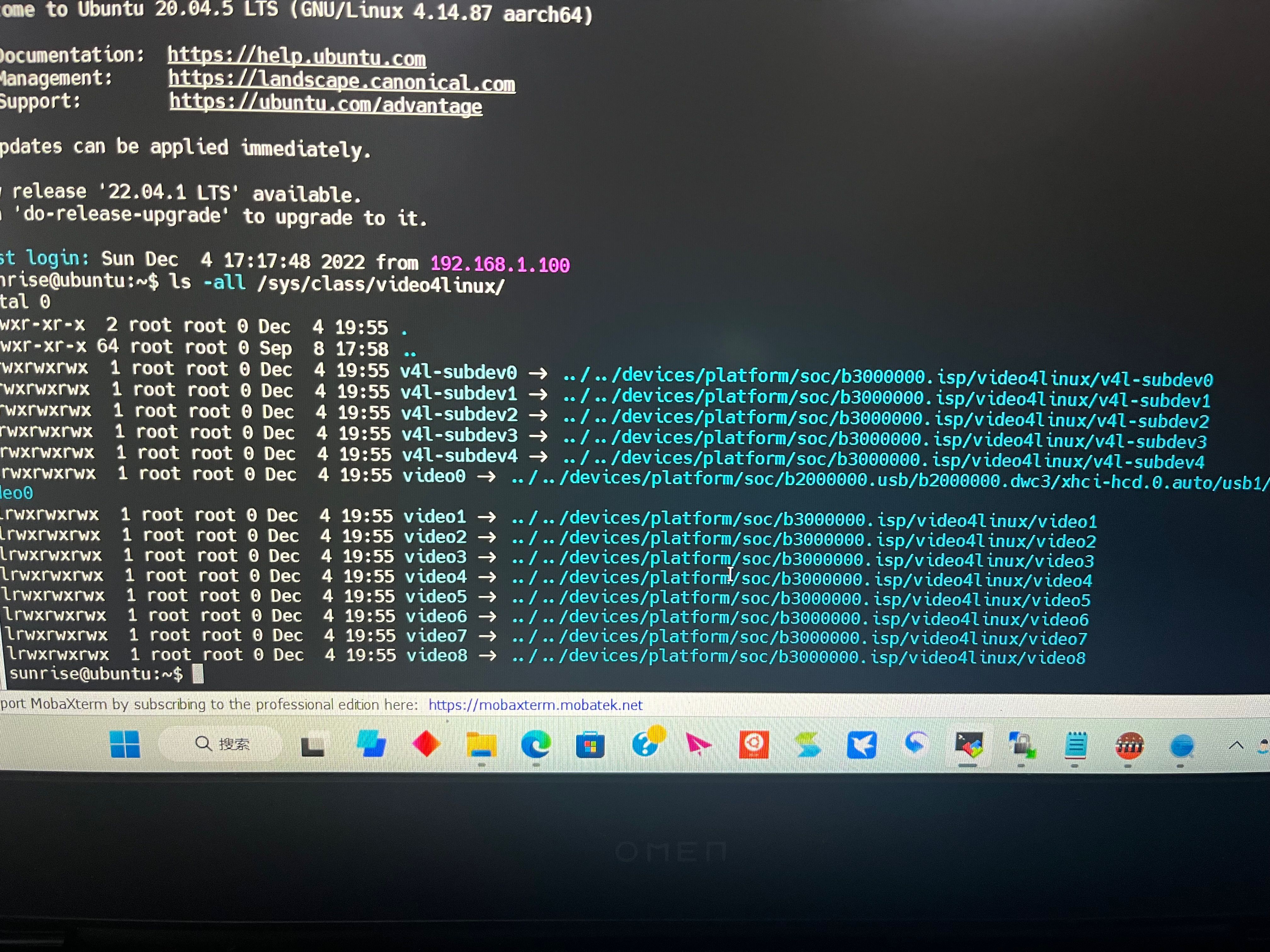

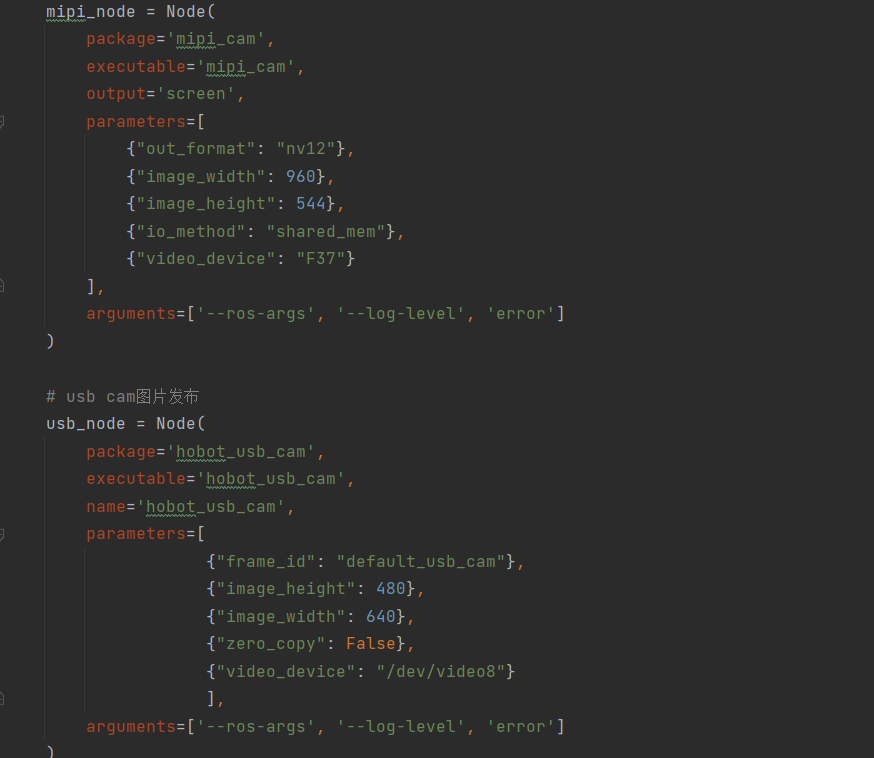

你好,我现在更新到tros1.1.3去编译,运行时候我摄像头路径在video0,脚本代码里video8我改成video0还是报错找不到video8,用mipi摄像头也是一样的问题,.launch文件和tros内部路径我都强制修改了还是找不到相应摄像头,请问是没有编译的原因吗

这个示例能跑成功吗:https://developer.horizon.ai/api/v1/fileData/TogetherROS/quick\_demo/demo\_sensor/usb\_camera.html

格式化旭日派,返回老版本hhp问题解决

改TROS里的配置不需要重新编译,按照上面链接操作,里面有详细说明。

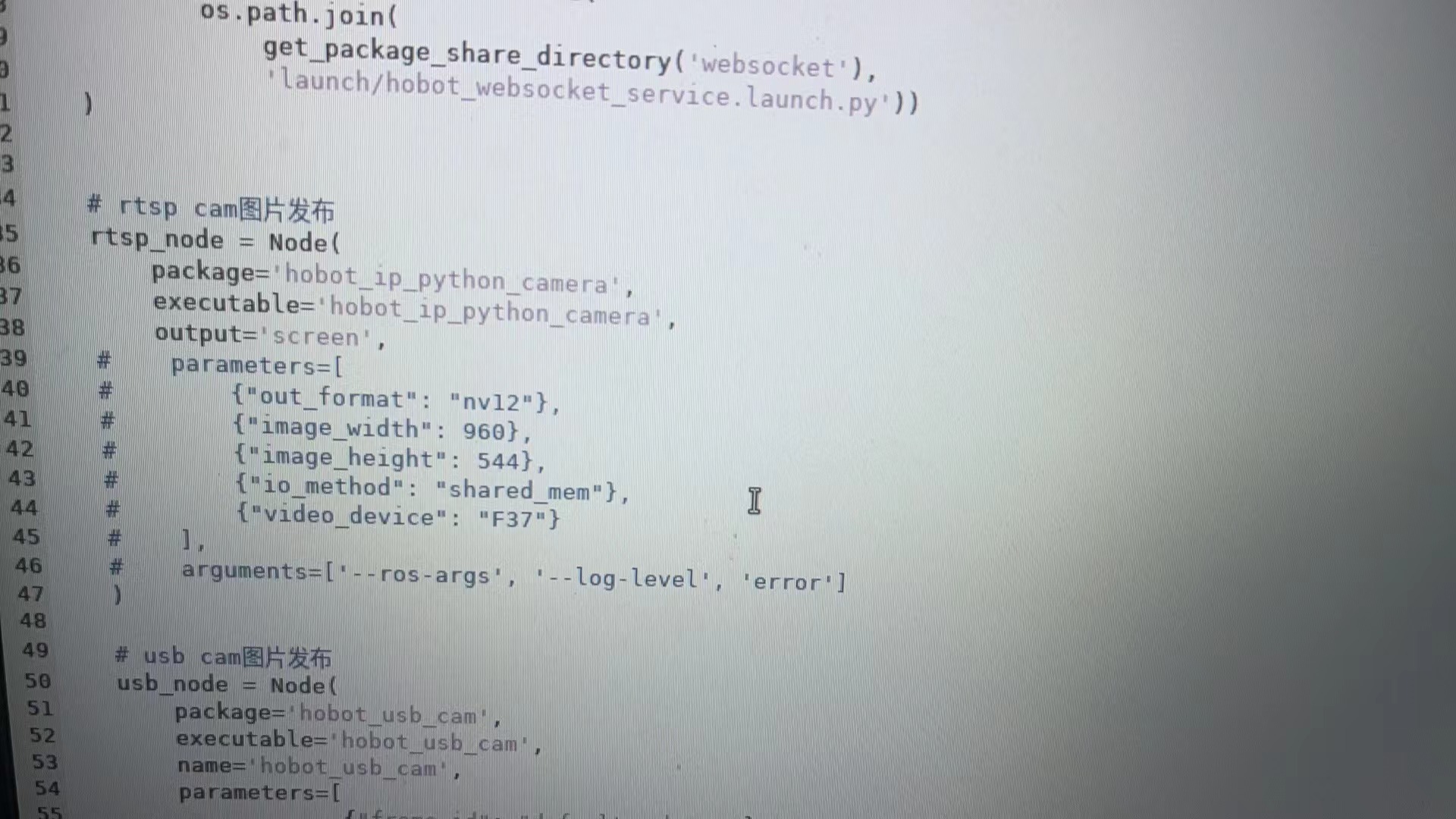

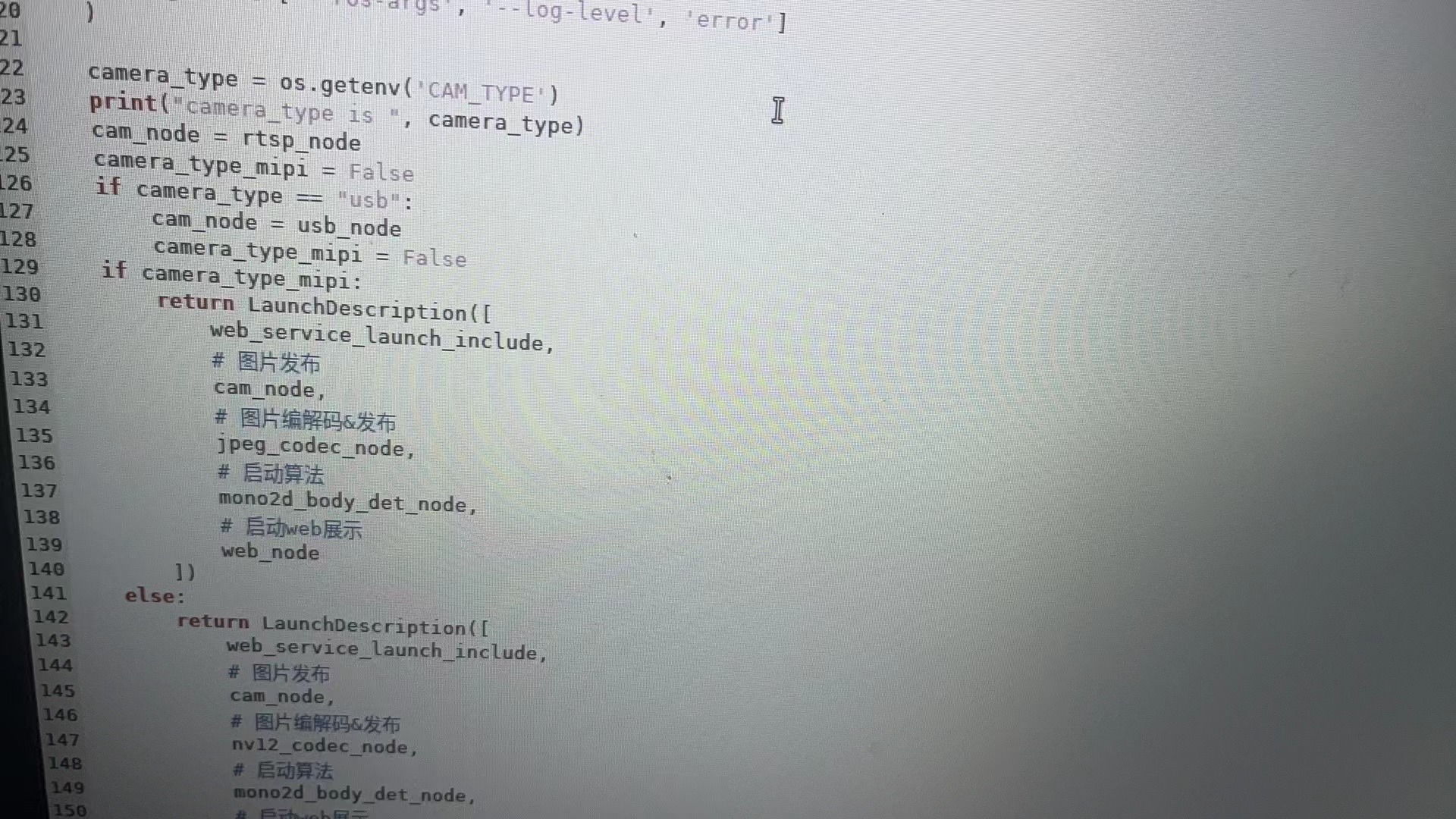

现在想用网络摄像机基于rtsp流运行骨架提取算法,我看launch文件只能基于usb和mipi摄像头输入图像,基于rtsp拉流输入图像可以实现吗,已经实现X3派08_decode_rtsp_stream的示例实现拉流

你好,现在想自己写一个rtsp的node,去拉网络摄像机的topic image,有模板吗

如果是修改launch文件不需要编译,https://developer.horizon.ai/api/v1/fileData/TogetherROS/quick\_demo/demo\_sensor/usb\_camera.html 这个链接里面有说明如果改配置。改C++代码需要重新编译。

https://developer.horizon.ai/api/v1/fileData/TogetherROS/quick\_demo/demo\_sensor/usb\_camera.html

可以参考这个手册里面对应的代码,拉取到rtsp流之后使用ros msg将数据流封装后发布出去。

usb cam是基于v4l2获取到图片之后使用ros msg将图片封装后发布出去。

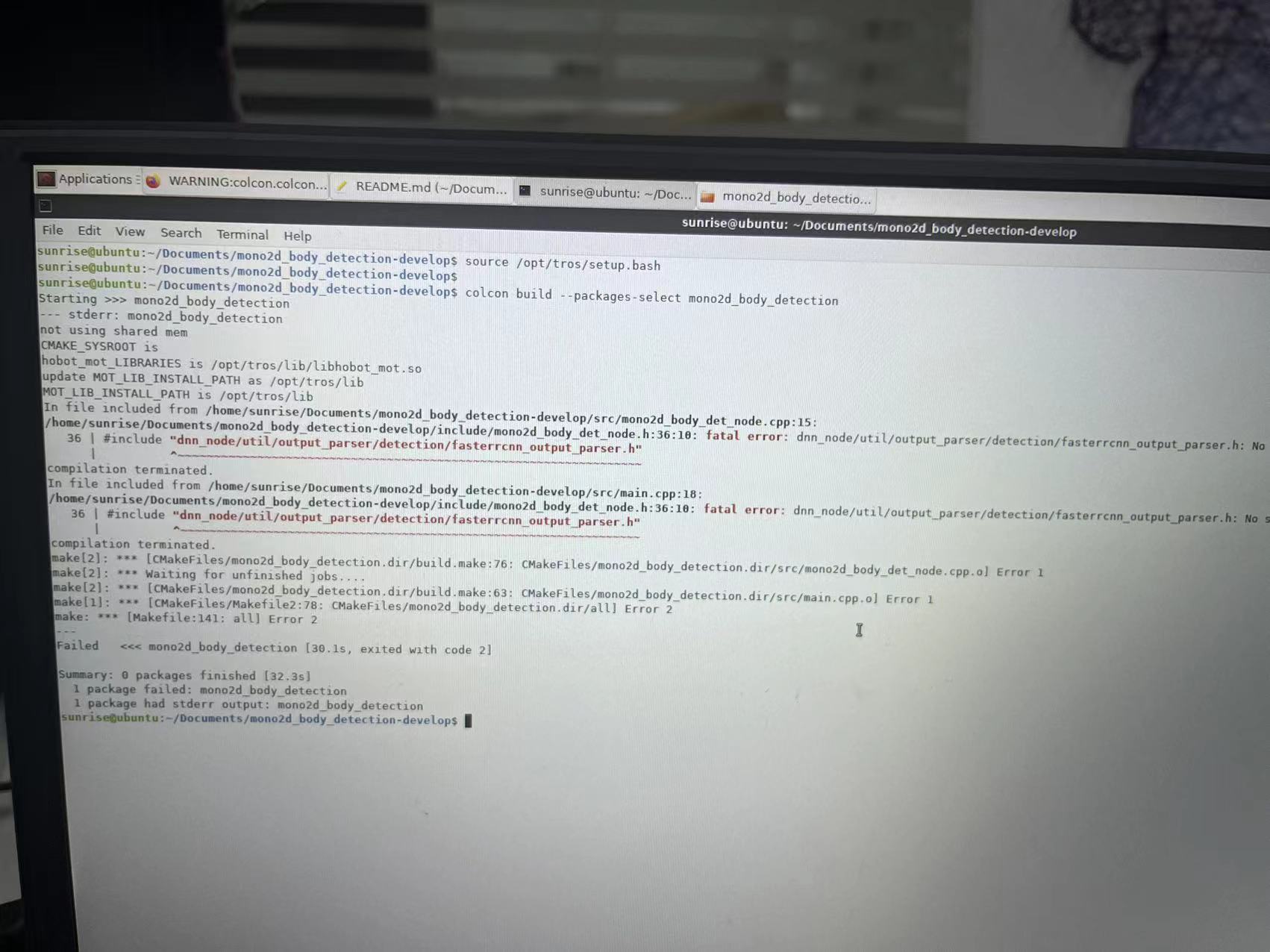

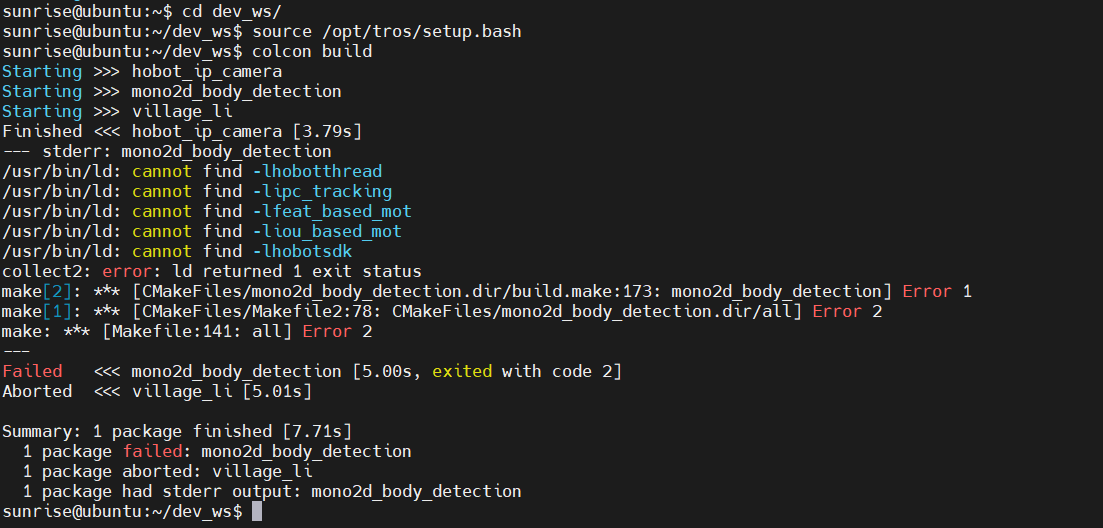

tros版本是多少?编译输出和CmakeList里面对不上,应该会有这些库对应路径的打印的:

message("MOT_LIB_INSTALL_PATH is " ${MOT_LIB_INSTALL_PATH})

tros用的hhp1.0.5,骨架提取算法也用的旧版本1.0.5