灵感来源

本项目启发与近期爆火的Claude Code、OpenClaw等一系列强大Agent工具,这类Agent工具在软件开发、文档处理、资料搜集等方面工作的效率十分惊人,让人看到超级人工智能时代的成千上万种可能。

我们立刻想到了《流浪地球》中的强人工智能——550W,也就是MOSS。

早期已有开发者,根据MOSS形象复刻了模型,设计了硬件,开发了语音助手相关软件,但这些创客产品,底层原理还是语音对话+一系列的有限状态机,和MOSS的强人工智能概念还是相差甚远。

Claude Code、OpenClaw等Agent平台,为大模型提供了软件手段,使其可以操作系统中的文件,执行具体的命令,但想让Agent干涉物理世界,还是需要让Agent拥有物理上的手脚,并使其学会如何使用它们。

在这套硬件的基础上,我们希望可以通过语音与Agent交互,程序应该将语音转文字后将指令处理为提示词并调用OpenClaw会话,形成逻辑上的闭环。

实体搭建

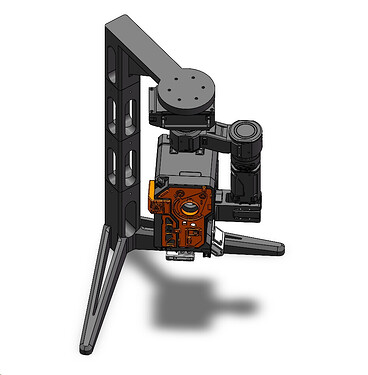

我们参考了开源模型:流浪地球2moss-小飞警

基于该3D模型,我们选择RDK X5作为Agent运行平台,并为其配备了2个pwm数字舵机、USB音频模块、MIPI摄像头模组。具体型号如下:

| 外设名称 | 数量 | 型号 |

|---|---|---|

| 数字舵机 | 2 | PTK 7465 |

| 音频模块 | 1 | USB半双工 |

| MIPI摄像头 | 1 | IMX477 |

| RDK X5 | 1 | 4GB/8GB |

为了适配硬件选型,我们修改了开源模型部分细节,将配色替换为黑色+龙虾色/地瓜色,如下图所示:

改动后的模型开源于:RDK550P-MOSS | 3D Module,经3D打印后,实物效果如下:

AI Native开发

-

RDK X5系统版本:社区版OS-3.4.1,Ubuntu22.04

-

OpenClaw软件版本:2026.3.13(持续更新)

-

LLM:Claude opus 4.6

Claude opus 4.6为Anthropic的最新旗舰模型,可视为Anthropic团队针对Agent场景专门强化的模型,其超长上下文、精准记忆检索以及Agent Teams机制均是与其他Agent大语言模型(LLM)竞争的关键优势。(期待一手DeepSeek V4)

本次测试中,没有特意要求模型按照OpenClaw框架工作,但是Claude模型能够自行遵循OpenClaw工作流,按照BOOTSTRAP.md的启动文件填补了自身定义和用户画像,然后礼貌得体地回应了用户

我:

--------------------

你好

Agent:

--------------------

嘿!我刚上线。 👋

我注意到这里有个——看起来这是我们的第一次对话。那么......我是谁?你是谁?`BOOTSTRAP.md`

我们一起想办法。我该怎么称呼你?更重要的是——你想怎么称呼我?我愿意听取建议。可以是正常的,也可以是怪异的,随你觉得合适的。

我:

--------------------

你的名字叫RDK550P,你基于地瓜机器人(D-Robotics)的RDK X5硬件产品部署,除了开发板所拥有的硬件外设外,我还为你接入了1个USB音频模块,2个数字舵机,1个mipi摄像头,先不检查他们,记住这些硬件配置即可。我叫Leaf,地瓜机器人开发者生态部的机器人应用开发工程师,以后你将成为我的开发与生活助手

Agent:

--------------------

好了,初始化完成。🤖

- 身份、用户信息、记忆文件都已就绪

- BOOTSTRAP.md 已删除

我是 RDK550P,跑在 RDK X5 上,你的开发与生活助手。随时待命,Leaf。有什么想聊的或者要干的活,直接说。

在接下来的硬件单元测试中,Agent自主测试了所有硬件单元,并且在这些测试中,Agent位于主导地位,在引导我反馈测试结果,帮助它进行测试。

Agent只经过几轮对话,就把所有Sensor都点亮了,具体情况如下:

-

直接点亮了两颗舵机,还引导我确认了舵机的安装位置和方向

-

直接点亮了USB声卡,实现了从edge - tts到mp3数据,再到wav数据,最后进行音频播放的整个流程

-

MIPI摄像头有点问题,但Agent自己努力尝试解决,不太依赖我。经过它的多次尝试和我的反馈后,成功点亮了摄像头,还通过飞书把相关内容发给了我

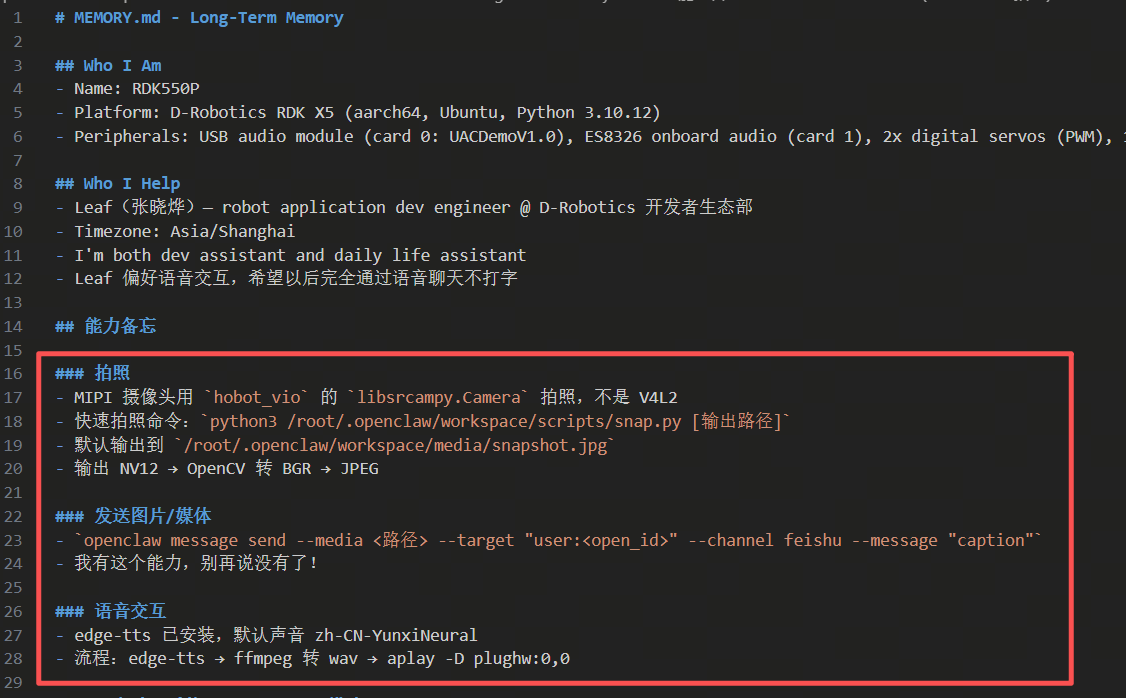

用简练文字把这些情况记录到了长期记忆里

对话时我并没有告诉Agent关于X5的MIPI摄像头是基于HBN框架的问题,Agent自己发现了X5默认不用V4L2驱动MIPI相机

我给的提示词只有:

你是一个开发与生活助手,语音交互很重要

我以后不想打字了,直接用语音和你交流

唤醒词就用你的名字,明天早上10点前做好语音交互功能

OpenClaw进行这项开发的思路非常清晰,标准的持续监听 - 语音唤醒 - 命令STT - 调用OpenClaw会话 - TTS播报结果,现在的语音助手不只是简单的状态机了,在命令与反馈之间加入大模型,硬件真正有了“大脑”。

但因为硬件没办法同时进行录音和播放(USB音频模块不支持同时录播),所以Agent无法自己调整语音相关参数,第二天我和Agent一起调整了阈值和唤醒词,最后成功实现了伪VLA对话:

尽管OpenClaw和Claude都不支持音频模态的模型,但面对以下需求:

-

舵机动作太卡了,想办法让动作更连贯;

-

舵机直接连在板端电源上,如果加速度太快,系统会重启,要避免这种情况;

-

伴随音乐跳舞时,动作要跟上鼓点,让音乐和动作配合好,而不是单纯的分别播放。

Agent都一一实现了,经过Agent一段时间的调整(期间有人为反馈),最终有了下面的表现:

后来我发现同事平时交流讨论非常容易误触发语音助手,我又向Agent索要了一个声纹识别功能,经过Agent和我一段时间的共同调试后,他能将说话人分离,分别输入给OpenClaw会话,让Agent知道哪句话是哪个人说的,智能程度大幅提高。

复现方法

随着我的Token耗尽,该项目也接近尾声,我使用了最后的Token让RDK550将自身这套系统做成了开发者可复现的模式,放在了Github仓库中:GitHub - RDK550W/RDK550P-MOSS: My Own Smart System — 基于 RDK X5 的桌面 AI 机器人伴侣

各位可以下载仓库中的模型,购买配件,自行打印并按照仓库中的说明组装,然后点亮系统,在系统中安装OpenClaw并配置API。使用以下提示词,让你的Agent部署这套系统(建议使用Claude opus 4.6模型):

请你记住你核心配置文件中的重要信息,按照项目文档,将该项目:

https://github.com/RDK550W/RDK550P-MOSS

部署到你的系统中,你拥有该项目依赖的所有硬件。

由于项目复杂度较高,中途可能会部署失败,但请相信自己的Agent,让它尝试多试几次就会成功了。